为什么选择《动手学深度学习》PyTorch版?

《动手学深度学习》PyTorch版是初学者从理论到实践的最佳指南,由李沐等作者2022年更新,豆瓣评分9.3分,定价85元,厚440页。相比Ian Goodfellow的《深度学习》理论密集型书籍,这本注重交互式Jupyter笔记本,直接运行代码避免脱节。2026年3月版本新增分布式训练内容,适应GPU集群趋势。

书籍从预备知识如Tensor操作和自动求导起步,到线性回归、CNN和RNN全覆盖。实践导向帮助理解梯度消失和过拟合的具体表现,通过调整超参数优化模型。

PyTorch基础:安装与Tensor操作

PyTorch是深度学习框架的核心,支持GPU加速,Tensor类似NumPy数组但更强大。从简单加法运算起步,能快速验证广播机制。

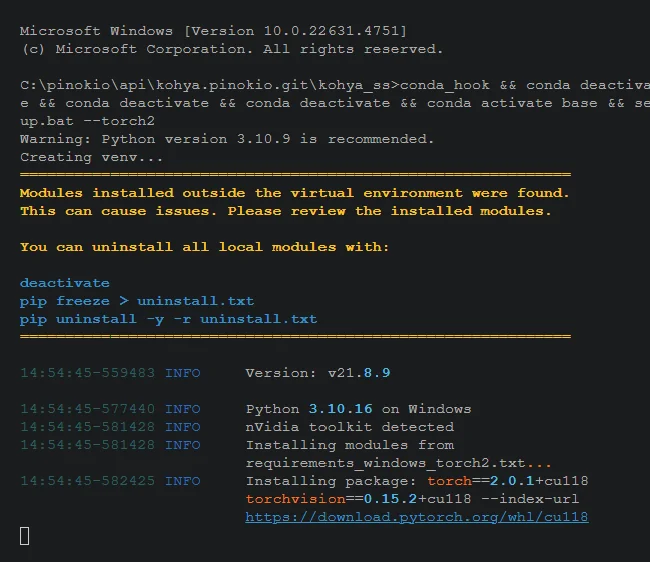

安装PyTorch的步骤

在2026年,使用conda创建环境是推荐方式,确保Python 3.10兼容性。以下是详细步骤:

步骤1: 打开终端,运行 conda create -n d2l python=3.10,创建名为d2l的环境。

步骤2: 激活环境 conda activate d2l,然后安装 pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121,针对NVIDIA GPU和CUDA 12.1。

步骤3: 启动Jupyter Notebook,导入 import torch,创建Tensor x = torch.tensor([1.0, 2.0, 3.0]),运算 y = 2 * x + 1,输出tensor([3., 5., 7.])。

广播机制与自动求导

广播机制允许维度不匹配的张量运算,如(3,)和(1,3)相加生成3x3矩阵。用torch.Size()检查形状避免错误。自动求导通过requires_grad=True实现反向传播,例如x = torch.arange(4.0, requires_grad=True); y = 2 * torch.dot(x, x); y.backward(),x.grad为[4,6,8,10],体现了链式法则。训练时开启,预测时关闭节省内存。

a = torch.arange(3).reshape((3,1)); b = torch.arange(3).reshape((1,3)); print(a + b)线性回归:深度学习的基础模型

线性回归模型y = Xw + b,使用MSE损失和梯度下降优化,是理解最小二乘法的起点。但它仅限线性关系,对图像等非线性数据无效。

生成数据集:用1000个样本,2个特征,加0.01噪声模拟真实场景。DataLoader以batch_size=10迭代数据,平衡内存和收敛。

| 方面 | 从零实现 | PyTorch简洁版 |

|---|---|---|

| 参数初始化 | torch.randn(2, requires_grad=True) | nn.Linear(2,1) |

| 优化 | 手动w.data -= 0.01 * w.grad | torch.optim.SGD(lr=0.01) |

| 损失 | 自定义squared_loss | nn.MSELoss() |

| 优点 | 理解细节 | 快速原型 |

训练3个epoch,学习率0.01,w和b接近真实值true_w=[2,-3.4]和true_b=4.2。更多细节见PyTorch优化算法指南。

model = nn.Sequential(nn.Linear(2,1)); optimizer = torch.optim.SGD(model.parameters(), lr=0.01); loss_fn = nn.MSELoss(); for X,y in loader: l = loss_fn(model(X), y); optimizer.zero_grad(); l.backward(); optimizer.step()softmax回归:多类分类入门

softmax将输出转为概率,结合交叉熵损失用于Fashion-MNIST数据集的10类服装分类。数据集含6万训练样本,28x28灰度图像,2026年仍为入门首选。

实现:用nn.CrossEntropyLoss()内置softmax,batch_size=256,5个epoch达80%准确率。类别不平衡时加权损失提升少数类准确率。

def softmax(X): X_exp = torch.exp(X - torch.max(X, 1, keepdim=True).values); return X_exp / X_exp.sum(1, keepdim=True)卷积神经网络(CNN):图像处理的利器

CNN通过卷积提取局部特征,参数共享减少计算,LeNet-5是1998年经典模型,2026年ResNet变体更流行。

从零实现:nn.Conv2d(1,6,kernel_size=5),MaxPool2d(2)下采样,ReLU激活优于sigmoid避免梯度消失。Adam优化器lr=0.001,10个epoch在GPU上达85%准确率。

class LeNet(nn.Module): def __init__(self): super().__init__(); self.conv1 = nn.Conv2d(1,6,5); self.fc1 = nn.Linear(16*5*5, 120); def forward(self, x): x = torch.relu(self.conv1(x)); x = torch.max_pool2d(x,2); return self.fc3(x.view(x.shape[0], -1))循环神经网络(RNN):序列数据的处理

RNN捕捉时序依赖,但长序列易梯度消失,LSTM通过门控机制解决。2026年Transformer主导,但RNN为基础理解必要。

简单实现:nn.RNN(input_size=vocab_size, hidden_size=256),在NLP如翻译中应用。训练需大量数据,少样本效果差。

rnn = nn.RNN(300, 128); output, state = rnn(X)优化技巧与应用场景

Adam结合动量收敛快,初始lr=0.001适合多数场景,但调参不当易局部最小。从SGD起步测试。在计算机视觉用YOLOv8,NLP用BERT预训练模型。

迁移学习:torchvision.models.resnet50(pretrained=True),小数据集节省时间。分布式训练用DDP,需InfiniBand缓解延迟。

局限:计算密集,训练GPT-4级需数千GPU,碳排放高。数据偏见用FairML审计。更多见深度学习局限性分析。

怎么安装PyTorch以支持GPU?

用conda创建环境python=3.10,pip安装torch --index-url https://download.pytorch.org/whl/cu121,针对CUDA 12.1,确保NVIDIA驱动兼容。

为什么线性回归是深度学习起点?

它揭示参数优化和损失计算本质,通过从零实现理解梯度下降,扩展到复杂模型如CNN。

CNN和RNN哪个适合图像任务?

CNN专为图像设计,通过卷积提取特征,准确率高;RNN用于序列如文本,不适合静态图像。

《动手学深度学习》适合哪些读者?

适合想写代码的初学者,有Jupyter笔记本实践;数学背景强读者可参考Goodfellow书补充理论。

深度学习训练需要多少GPU资源?

中型模型如ResNet-50用单RTX 4090几小时;大型如GPT-4需数千GPU,碳排放相当于几辆车一生。