CNN核心概念

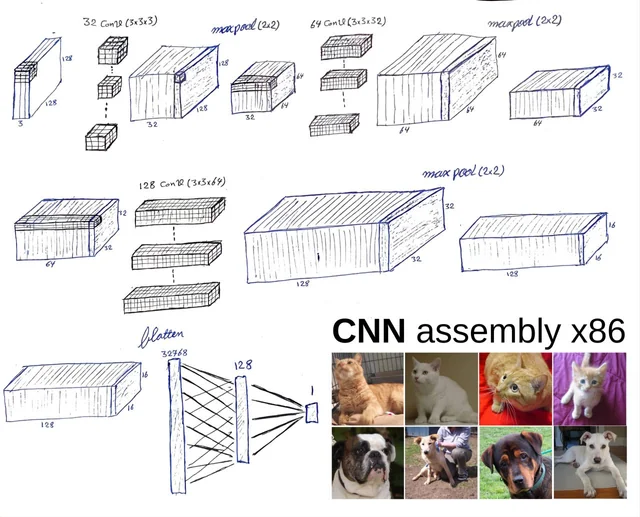

CNN是一种深度学习模型,通过局部连接和参数共享高效处理图像数据,避免传统神经网络在高维输入时的计算爆炸。初次接触时,它像黑盒从像素中提取轮廓,但核心是层层过滤和抽象过程。以猫照片为例,网络关注局部特征生成特征图。2012年AlexNet在ImageNet竞赛中以15.3%错误率领先,开启计算机视觉浪潮。到2023年,CNN支持实时视频分析如自动驾驶行人识别。

卷积操作与参数共享

卷积操作让CNN关注图像局部特征,卷积核如小窗口滑动扫描边缘或纹理生成特征图,比全连接网络高效,后者参数量急剧增加。参数共享的优势在于一个滤波器重复使用,减少冗余。以3x3卷积核为例,仅9个参数捕捉所有位置边缘,而全连接层参数呈平方增长,在百万像素图像中易崩溃。

实践中,步长设置关键:步长1适合精细特征,步长2加速下采样但可能丢失细节。从stride=1开始监控尺寸。

步长选择指南

步骤1:初始化卷积层,设置stride=1以保留细节。

步骤2:计算输出尺寸,确保不意外缩小。

步骤3:若需加速,渐增stride至2,验证特征提取效果。

激活函数与池化层

ReLU激活函数将负值置零,帮助网络更快收敛,2020年基准测试显示在CIFAR-10上准确率超95%,训练速度比Sigmoid快10倍。它避免梯度消失,而Leaky ReLU在噪声任务中提升2-3%准确率,但可能放大噪声。

池化层降维增强平移不变性,最大池化突出显著特征,2x2最大池化可靠起点,将尺寸减半使模型鲁棒。但过度池化丢失位置信息,在医疗图像中不宜用。

| 组件 | 优势 | 缺点 | 适用场景 |

|---|---|---|---|

| ReLU | 快收敛,避免梯度消失 | 死神经元风险 | 图像分类 |

| 最大池化 | 增强不变性,无参数 | 丢失细节 | 特征提取 |

不变性与等变性

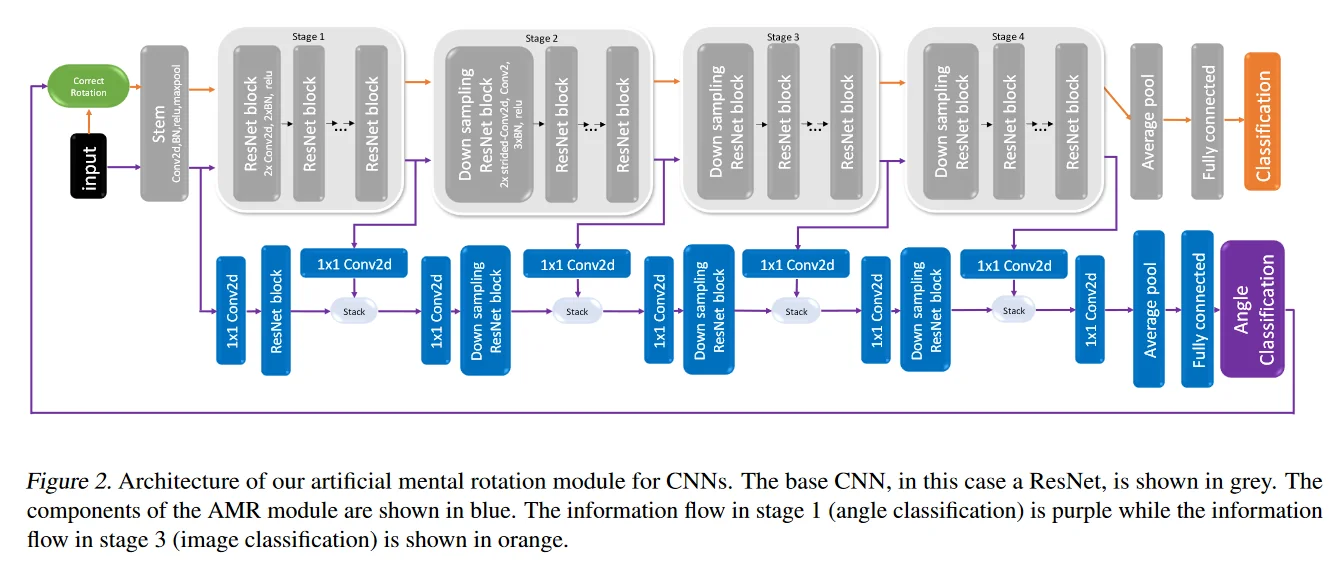

CNN设计强调不变性和等变性,不变性确保输入变换后输出不变,等变性使输出相应变换。2014年Hinton指出共享权重实现平移等变性,便于学习。等变性捕捉空间关系,不变性适合分类,但过度追求不变性忽略细节,在实时跟踪中断连续性。

2023年Transformer融合CNN等变与注意力,提升多模态任务15%性能。平衡两者根据任务,如视觉生物学支持等变性。

深度学习不变性优化技巧从头实现CNN

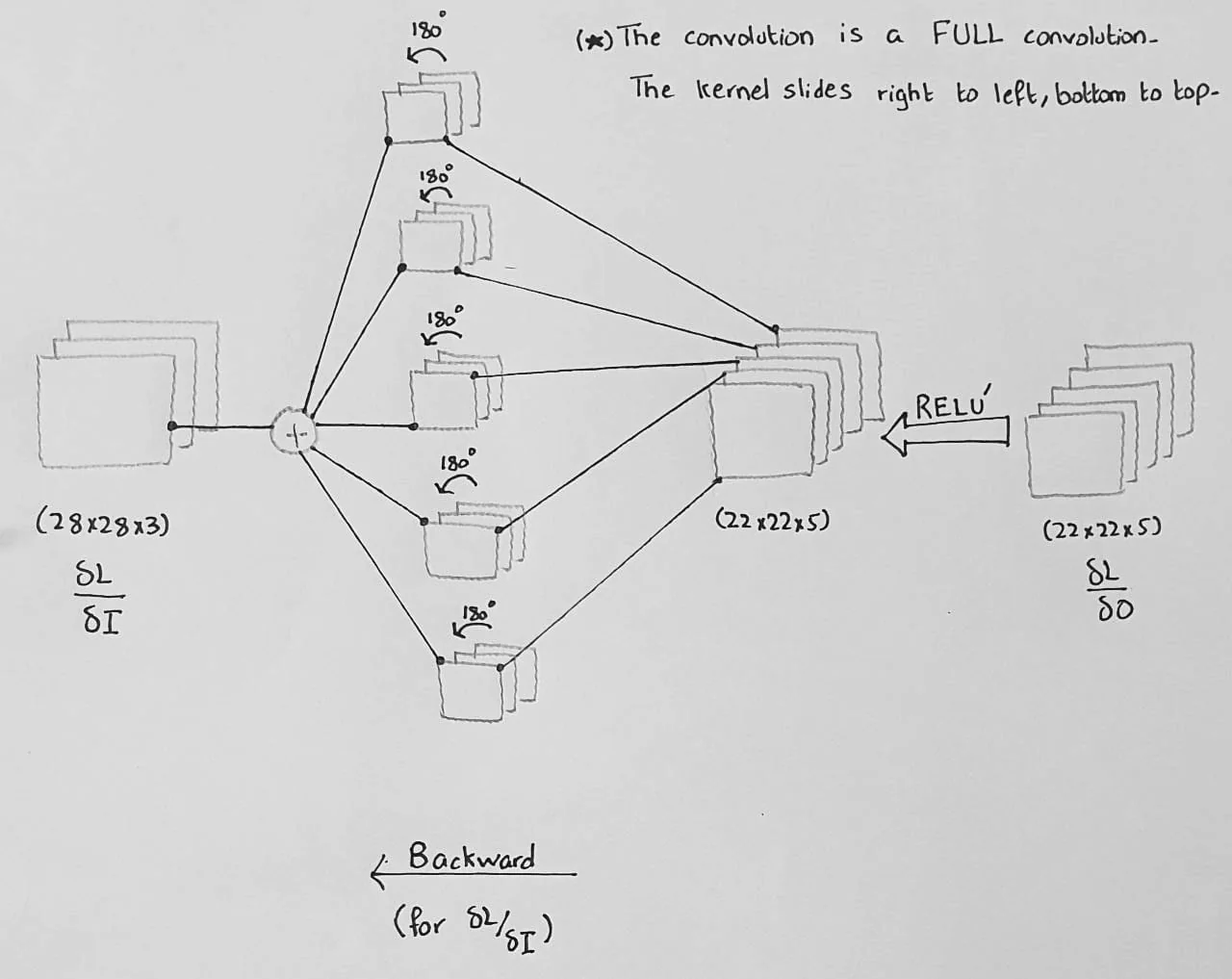

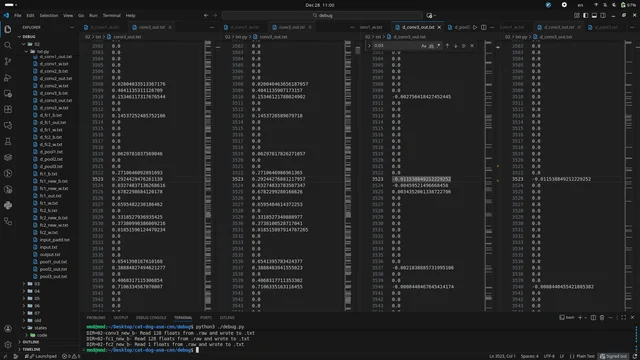

从头实现CNN用Python和NumPy理解本质,输入28x28灰度图像。卷积函数需双层循环计算点积,添加ReLU和池化后堆叠层,用SGD优化。

def conv2d(image, kernel, stride=1):

h, w = image.shape

kh, kw = kernel.shape

out_h = (h - kh) // stride + 1

out_w = (w - kw) // stride + 1

output = np.zeros((out_h, out_w))

for i in range(out_h):

for j in range(out_w):

output[i,j] = np.sum(image[i*stride:i*stride+kh, j*stride:j*stride+kw] * kernel)

return output

# 添加ReLU

output = np.maximum(0, output)2016年课程训练MNIST达98%准确率。批量归一化加速收敛,但小批量易过拟合。

步骤1:实现卷积函数,验证输出尺寸公式out_h = floor((h - kh + 2*pad)/stride) + 1。

步骤2:添加ReLU和池化,堆叠多层。

步骤3:用反向传播训练,监控验证损失。

正则化与应用扩展

正则化防止过拟合,Dropout丢弃0.5神经元,2020年ImageNet实验降低3%泛化误差。CNN扩展到物体检测,YOLO v8 2023年mAP达55%;U-Net用于分割,医疗CT减少20%假阳性。

CNN在医疗图像应用案例优点:参数少、并行计算;缺点:需GPU、黑箱性。小数据集用预训模型微调,节省80%时间。

Q: CNN如何避免计算爆炸?

A: CNN通过局部连接和参数共享减少参数量,例如3x3核只需9参数,远低于全连接层的平方增长。

Q: ReLU激活函数为什么优于Sigmoid?

A: ReLU避免梯度消失,训练速度快10倍,在CIFAR-10上准确率超95%。

Q: 池化层是否必需?

A: 池化非必需,现代如ResNet用步长卷积替代,但对初学者2x2最大池化可靠,提供平移不变性。

Q: 如何从头实现CNN?

A: 用Python NumPy写卷积函数,双层循环计算点积,添加ReLU和池化,SGD训练MNIST达98%准确率。

Q: CNN适合哪些任务?

A: CNN首选静态图像分类和检测,如YOLO v8实时视频mAP 55%,不适合序列数据,转用ConvLSTM。