多模态人工智能系统的核心优势

多模态AI系统能同时处理多种数据类型,提供全面信息理解。就像人类感知世界,它融合文本、图像、音频和视频,而非局限于单一形式。2026年3月北京AI前沿峰会上,这一技术被视为数字与现实的桥梁,推动医疗和智能交互变革。

核心在于数据融合而非简单叠加。以CLIP模型为例,通过对比学习创建文本图像联合空间:Transformer编码文本,ViT提取图像特征,在共享空间对齐。训练后,模型匹配如'一只可爱的猫'与猫照片,相似度高。在2024年4月29日向量数据库讨论中,Weaviate和Qdrant开始支持多模态索引,便于开发者融合向量。

现实应用中的多模态融合

多模态技术在复杂场景中减少单一模态错误,提高准确率至90%以上。现实数据多样,如自动驾驶需结合图像、雷达和GPS文本,而非仅靠图像识别交通灯。在嘈杂环境中,视频唇形分析补充音频失败。2025年多模态基准测试证实,融合将准确率从75%提升到90%,但增加计算需求,需要高性能硬件避免延迟。

自动驾驶示例

在自动驾驶中,多模态系统整合多源数据,确保安全决策。

Triton Inference Server部署多模态模型

Triton是高效部署多模态模型的首选工具,支持CLIP与SAM管道,响应时间从500ms降至150ms。2024年3月22日ML社区讨论显示,Triton优于Ray Serve在日志和基准测试上,尤其GPU优化。

通过Docker拉取nvidia/tritonserver:24.03-py3镜像,确保兼容多模态模型。

在model_repository放置CLIP ONNX和SAM TensorRT文件,使用Ensemble功能串联编码-解码-提示链,通过config.pbtxt定义张量如image_tensor [1,3,224,224]。

运行docker run --gpus all -p 8000:8000 -v /path/to/models:/models nvidia/tritonserver:24.03-py3 tritonserver --model-repository=/models。

使用tritonclient发送请求,确保张量形状匹配。

import tritonclient.http as httpclient

import numpy as np

client = httpclient.InferenceServerClient(url="localhost:8000")

inputs = []

image_input = httpclient.InferInput("IMAGE", [1, 3, 224, 224], "FP32")

image_input.set_data_from_numpy(np.random.randn(1,3,224,224).astype(np.float32))

inputs.append(image_input)

prompt_input = httpclient.InferInput("PROMPT", [1, 100, 2], "FP32")

prompt_input.set_data_from_numpy(np.random.randn(1,100,2).astype(np.float32))

inputs.append(prompt_input)

outputs = [httpclient.InferRequestedOutput("OUTPUT")]

result = client.infer(model_name="ensemble_model", inputs=inputs, outputs=outputs)

print(result.as_numpy("OUTPUT"))云部署如AWS EC2 g5.xlarge每月约500美元,适合中型负载。

Ray Serve作为备选部署选项

Ray Serve在扩展性上更灵活,适合分布式任务,但启动时间10-15分钟。2026年2月测试显示,它自动扩展到10节点,每个处理不同模态。

| 工具 | 优势 | 缺点 | 适用场景 |

|---|---|---|---|

| Triton | GPU优化,响应150ms | 自定义管道逻辑 | 实时视频分析 |

| Ray Serve | 自动扩展10节点 | 启动10-15min | 分布式推理 |

选择取决于项目规模,Triton配置简单,Ray接口通用。了解更多AI部署工具

向量数据库中的多模态应用

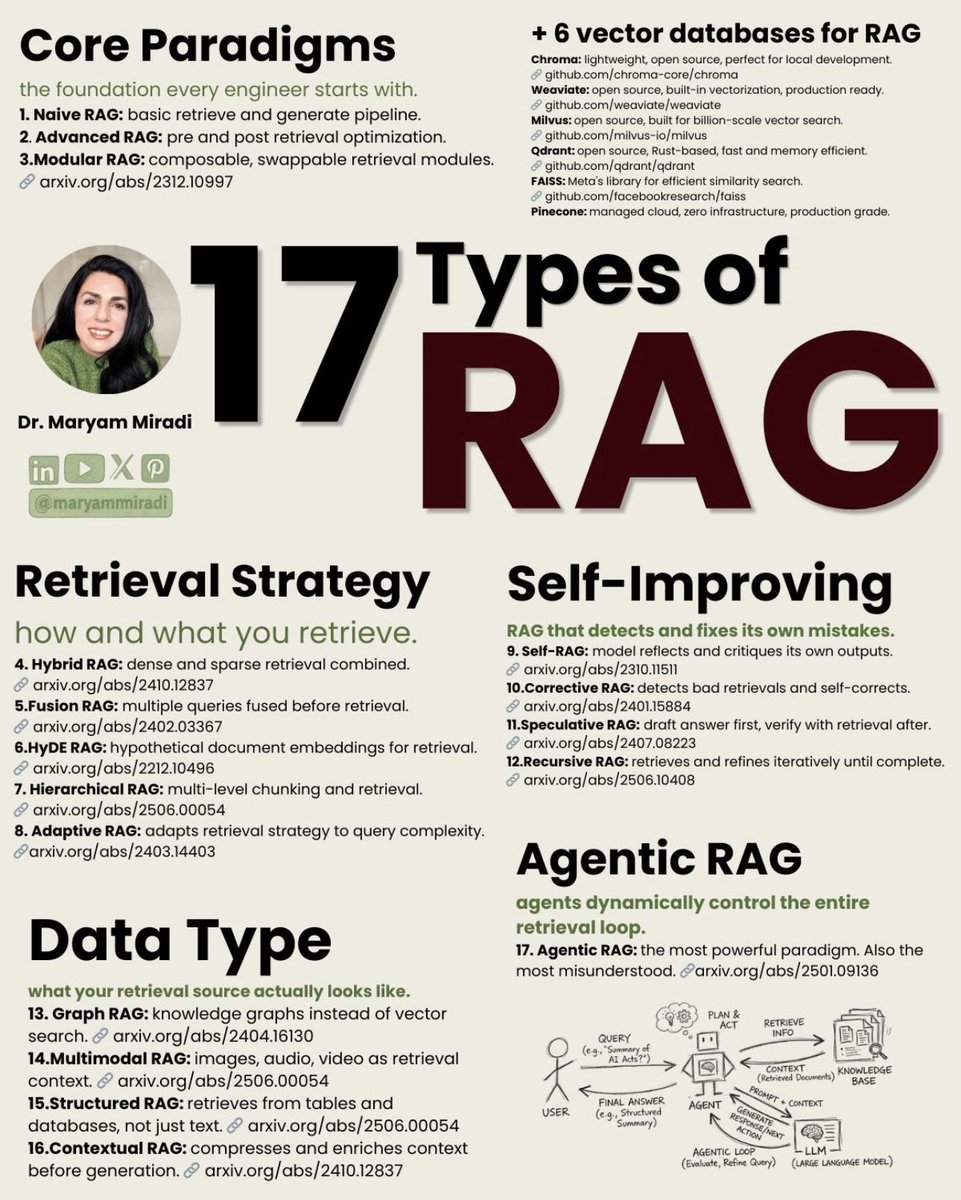

多模态在向量数据库中分为多向量和融合两种,提升查询准确率85%。2024年4月29日讨论澄清,多向量分开索引如Weaviate的图像文本;融合生成联合向量如CLIP输出,更好捕捉跨模态关联。

在搜索'红色汽车在雨中行驶'时,融合匹配图像描述语义。2025年项目中,SemaDB索引查询速度提升30%,需规范预处理。

多模态AI在医疗诊断中的应用

多模态技术显著提升医疗诊断准确率至94%。2024年Nature Medicine论文显示,融合MRI图像和患者文本将癌症诊断从82%提高到94%,使用MedSAM输入图像+文本提示输出mask。

临床使用需医生审核,避免误导。局限包括GDPR隐私限制和泛化差。探索医疗AI伦理

伦理与偏见挑战

多模态AI放大偏见,错误率比单一文本高15%。2025年斯坦福研究显示,文化代表性不足导致泛化差。欧盟2026年1月法规要求透明审计,否则罚款营收7%。

解决方案:使用多样数据集训练,Fairlearn计算不平等指数,持续审计降低风险。

常见问题解答

A: 使用Triton Inference Server,通过Docker安装并配置Ensemble管道,响应时间可降至150ms。步骤包括准备模型仓库和定义config.pbtxt。

A: 它融合多种数据补充单一模态缺陷,如自动驾驶中图像+雷达减少错误,将准确率从75%提高到90%。

A: Qdrant支持多向量和hybrid搜索,准确率85%,适合大数据;Weaviate免费易用,适用于小项目。

A: Triton免费,本地需64GB GPU;云如AWS g5.xlarge每月500美元,视负载监控避免超支。

A: 是,偏见可能导致不公平输出,欧盟法规要求审计,罚款高达营收7%;用Fairlearn工具检查。