课程概述

李宏毅的机器学习课程以生动例子拆解复杂算法,帮助中文初学者从零起步。2021年春季台湾大学公开课从基本概念到深度学习,提供完整路径,历时四个多月。新浪财经2021年3月6日报道课程更新,视频和PPT上传主页,覆盖过拟合和动量等关键问题。他的讲解像日常聊天,抓住要点,让机器学习易触及。

深度学习基础

课程核心是机器学习用数据训练模型预测,深度学习通过多层神经网络模拟大脑。第一堂课用日常生活场景如猫狗图片分类引入,避免分心。基础是梯度下降:最小化损失函数L(θ) = (y - f(x;θ))^2,更新θ = θ - η * ∂L/∂θ,η为学习率。第二堂课解释网络停滞原因,如鞍点或局部最小值,基于实际经验避免盲目调试。

实践步骤:复现神经网络

上手实践复现简单神经网络,用Python和PyTorch在Google Colab实现MNIST分类器,2026年3月运行只需10分钟,准确率超85%。

在Colab新笔记本运行!pip install torch torchvision。然后import torch; import torch.nn as nn; import torchvision.transforms as transforms; from torchvision.datasets import MNIST。定义transform = transforms.Compose([transforms.ToTensor()]); train_dataset = MNIST(root='./data', train=True, transform=transform, download=True); train_loader = torch.utils.data.DataLoader(dataset=train_dataset, batch_size=100, shuffle=True)。

class Net(nn.Module): def __init__(self): super(Net, self).__init__(); self.fc1 = nn.Linear(28*28, 500); self.fc2 = nn.Linear(500, 10); def forward(self, x): x = x.view(-1, 28*28); x = torch.relu(self.fc1(x)); x = self.fc2(x); return x。

model = Net(); criterion = nn.CrossEntropyLoss(); optimizer = torch.optim.SGD(model.parameters(), lr=0.01); for epoch in range(5): for images, labels in train_loader: outputs = model(images); loss = criterion(outputs, labels); optimizer.zero_grad(); loss.backward(); optimizer.step()。注意批次大小别超硬件,损失不降调lr到0.001。

# 示例训练循环

for epoch in range(5):

for images, labels in train_loader:

outputs = model(images)

loss = criterion(outputs, labels)

optimizer.zero_grad()

loss.backward()

optimizer.step()

强化学习部分

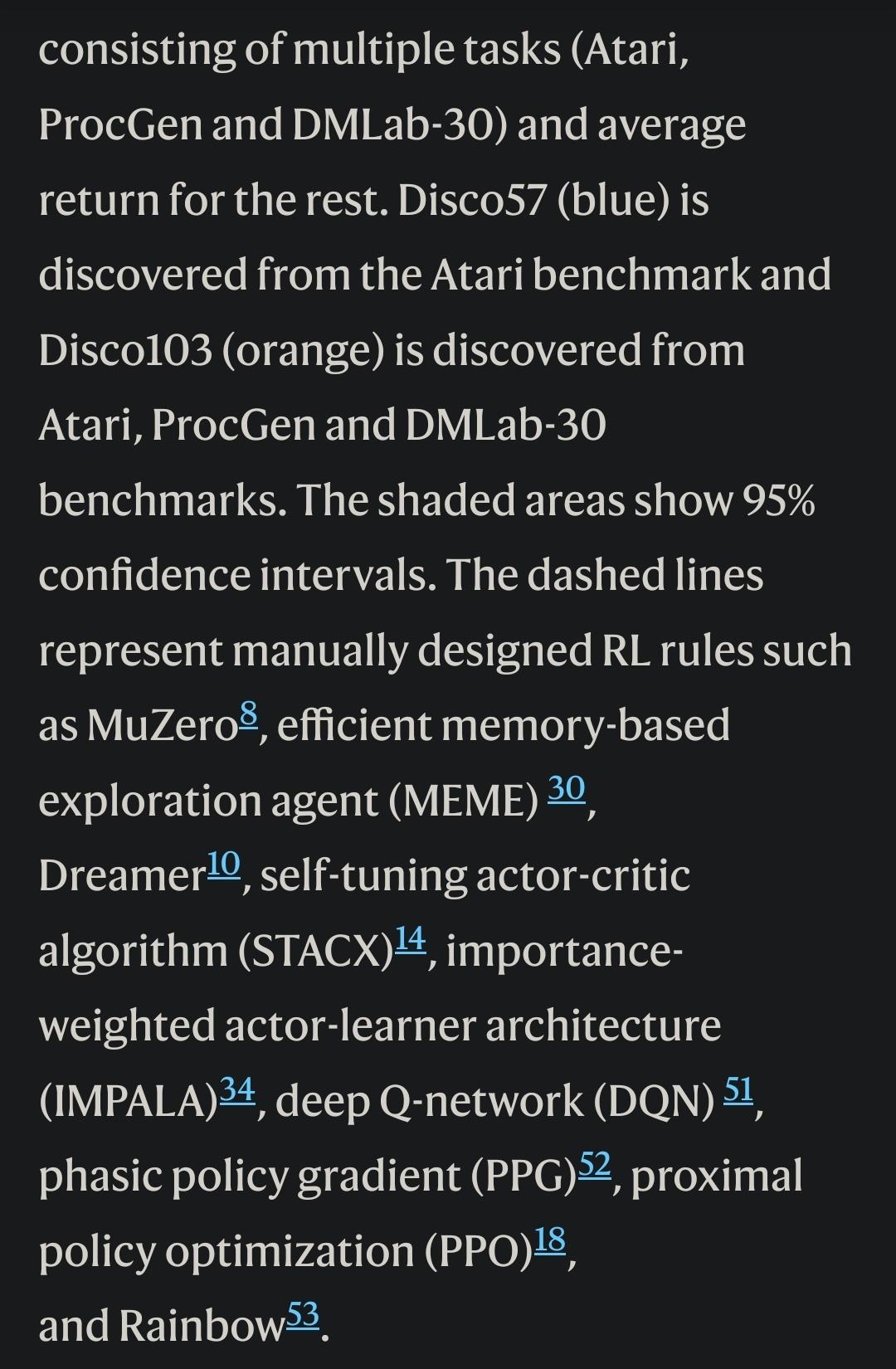

课程延伸到强化学习,李宏毅讲解出色,2020年11月25日开源《LeeDeepRL-Notes》项目由Datawhale整理,历时四个月实现100%复现,包括PPO和DQN。用Atari游戏举例Q-learning:Q(s,a) = r + γ max Q(s',a'),γ折扣因子。演员-评论员算法生动,避免数学枯燥。

策略梯度实践

策略梯度优化π(a|s),梯度∇J(θ) ≈ E[∇logπ(a|s;θ) * A(s,a)]。用PyTorch定义网络,采样轨迹计算回报G_t,更新θ += α ∇logπ * (G_t - b)。

课程对比

李宏毅课程更适合中文母语者快速入门,对比吴恩达Coursera:吴恩达2011年起流行,全英文强调数学,节奏慢;李宏毅用台湾普通话,PPT可视化,2021年新增Transformer,幽默适合碎片学习。豆瓣2025年2月27日讨论显示,李宏毅深度学习部分更易懂,项目完成率高30%。

| 方面 | 李宏毅课程 | 吴恩达课程 |

|---|---|---|

| 语言 | 中文(台湾普通话) | 英文 |

| 风格 | 互动讲座,幽默生动 | 系统教材,严谨数学 |

| 时长/节奏 | 四个多月,碎片友好 | 慢节奏,需自律 |

| 更新 | 2021 Transformer等 | 广覆盖基础 |

| 证书 | 纯开源免费 | 可选付费49美元 |

局限与建议

课程偏应用,数学推导不全面,如RNN只基础,到2026年大模型覆盖不足。假设编程经验,零基础易卡壳;Colab免费版有时限。建议结合Python基础教程先补课,用Colab Pro每月9.99美元跑强化学习如CartPole PPO,奖励从200升到500。

A: 它用中文生动例子平衡理论实践,适合初学者快速上手,避免英文课程的抽象推导,2021春季课覆盖完整路径。

A: 打开新笔记本安装PyTorch,加载MNIST数据集定义简单网络,运行5个epoch训练,注意学习率0.01,10分钟达85%准确率。

A: 李宏毅更适合,幽默互动讲座碎片时间学,项目上手快;吴恩达需三月深挖数学,适合有时间者。

A: 需要Python基础和监督学习知识,用Gym环境如CartPole实践PPO,Colab免费GPU够小项目,但大模型需Pro版。

A: 偏应用数学不全,2026年大模型覆盖不足,但基础如梯度下降和动量适用于Stable Diffusion,建议补NeurIPS论文。

行动起来:访问NTU机器学习资源,从2021春季第一堂视频开始,结合GitHub笔记跑项目。